אומרים שמצלמה לא משקרת אבל עם טכנולוגיית ה-"דיפ-פייק", זה לגמרי המצב: הזיופים הויזואליים העמוקים יכולים לגרום לכל אחד להיראות כאומר משהו שמעולם לא אמר. הטכנולוגיה המתקדמת מאפשרת ליצור סרטונים מזויפים, שנראים ממש כמו הדבר האמיתי באמצעות כלים של בינה מלאכותית. התופעה החדשה הזו מטרידה לא רק פוליטיקאים, אלא גם שירותי מודיעין ברחבי העולם, ומאיימת לשנות לחלוטין את כללי המשחק הפוליטי.

כל העדכונים על הבחירות - הצטרפו לטלגרם של החדשות

אם צפיתם בסרטון שבו בני גנץ שוכח את הטקסט ומישהו לוחש לו מה לומר, וחשבתם שבמטה כחול לבן עשו טעות, אז הצליחו לעבוד עליכם. קטע הוידאו הזה נולד בכלל בעמוד הפייסבוק הפארודי "WAKO", אבל מהר מאוד הוא שותף מספר רב של פעמים וצבר הרבה צפיות בעמודים פוליטיים הימניים כהוכחה לכך שיש מי שלוחש על אוזנו של גנץ.

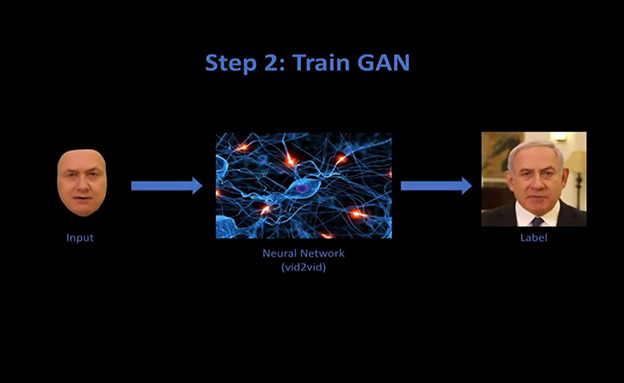

כדי לזייף סרטון דומה לא צריך להיות מומחה. עורך הוידאו של "VOCATIV" הציג לכתב החדשות עומרי ברק איך זה עובד. בתוך חצי שעה הוא ערך סרטון בו שתל את גלגול העיניים והלחישה. אדם נוסף השולט במיומנות הוא בר הללי, חוקר בינה מלאכותית, שהחליט השבוע להציג את טכנולוגיית ה-"דיפ-פייק" על פרצופו של ראש הממשלה, בנימין נתניהו.

"בתקופת הבחירות אנחנו מוצפים בחדשות שקריות בלי סוף, וחשבתי שזה זמן טוב להוציא וידאו כזה כי צריך להיות ערניים לדברים כאלה", סיפר הללי. הוא הסביר כיצד הצליח: "לקחתי סרטון אחד של נתניהו באורך של שלוש דקות וסרטון אחד מכיל הרבה מאוד פריימים. הדבר הזה ייצר כמה אלפי דוגמאות שבעזרת אלפי הפריימים ניתן לייצר מודל תלת ממדי, תמונה אמתית של המקור עם הפוזיציית ראש שלי והבעות פנים שלי. זה וידאו שגם שרה נתניהו לא תוכל לזהות אם זה ביבי".

"מנהיגים פוליטיים יהיו צריכים להכחיש דברים שכאילו אמרו"

שי ניסני, סטאראפיסט בחברת "VIVO TEXT" הציג באיזו קלות אפשר לגרום לאנשים לומר דברים שמעולם לא אמרו. ניסני הציג באיזו קלות אפשר לגרום לאנשים לומר דברים שמעולם לא אמרו. "שילבנו את קטע שהוקלט עם טכנולוגית וידאו שמראה את האדם עם ליפסינג מתאים ואז גם ראינו וגם שמענו - לכן זה מקנה אמינות", הסביר ניסני.

מתי כוכבי, מייסד ובעלים של קבוצת AGT הסביר: "זה קיים וזו טכנולוגיה פנומנאלית. אתה יכול לקחת אותי בדיפ פייק ולעשות איתי ריאיון ואתה תוכל להכניס מסרים שמעולם לא אמרתי". הוא הוסיף: "בוודאי שאפשר להשתמש בזה לצרכים פוליטיים ואנחנו גם לא נשים לב. מנהיגים פוליטיים יהיו צריכים לקום ולהגיד 'לא אמרנו את זה' ואנשים יגידו 'אבל ראינו אתכם אומרים את זה' זה יהיה האתגר".

בפנטגון הבינו כי ה"דיפ פייק" עלול להוות איום אסטרטגי: כבר כמה חודשים שעובדים שם על פיתוח של טכנולוגיות שיזהו את הסרטונים המזויפים. אתרי פורנו ופורומים שונים ברחבי העולם כבר אסרו על העלאה של תוכן של כזה. אז בחירות 2019 אמנם מלאות בפייק ניוז וטינופים מכל הצדדים, שימוש כזה בסרטונים מזויפים עדיין לא ראינו אבל נותר עוד כשבוע ליום הבחירות ועד אז הכל פתוח.